Актуальні теми

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Якщо ви читаєте щось на цьому тижні, пропоную наведений нижче звіт про штучний інтелект:

«Від виробників даних до світових моделей»

Вона переплітає процеси обробки даних, контекстну інженерію, середовища RL, моделі світу та багато іншого в доступний, але всеосяжний нарис про сучасну межу штучного інтелекту. 👇

Повна стаття:

🧵нижче:

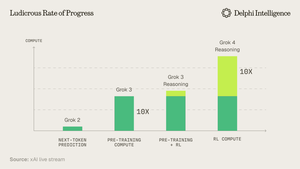

1) З релізу Grok 4 стає зрозуміло, що ми не вдарилися об "стіну" в обчислювальних витратах.

Джерело: @xai

2) Все частіше з'являються дані як коротка жердина в наметі.

Джерело: @EpochAIResearch

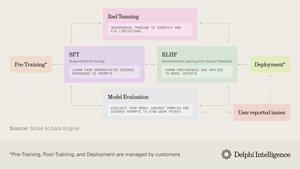

3) Більша частина цих витрат йде на створення високоякісних наборів даних для пост-навчання, які швидко наближаються до 50% обчислювальних бюджетів

4) Це призвело до різкого зростання попиту на «виробників даних», таких як @scale_AI @HelloSurgeAI @mercor_ai & more, які допомагають отримувати необхідний досвід і створювати конвеєри даних, необхідні для RL, у доменах, які не піддаються перевірці...

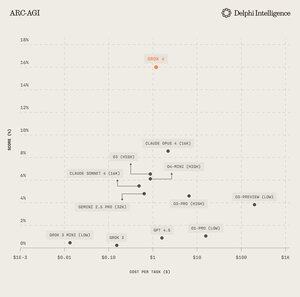

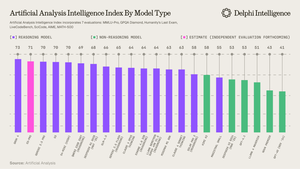

5) Що може сприяти підживлюванню все більш здібних моделей міркування, очевидно, парадигми масштабування du jour per @ArtificialAnlys

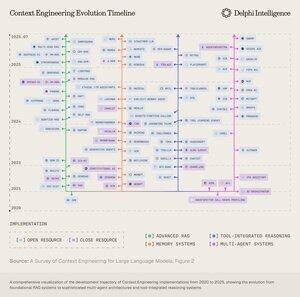

6) І все ж, моделі обмежені вже не IQ, а контекстом. Оперативний інжиніринг передав естафету «Context Engineering» - галузі, що розвивається, що оптимізує інформаційні корисні навантаження для LLM.

7) Простір надзвичайно динамічний, але загалом тягне за собою масштабування контексту за 2 векторами:

1. Довжина контексту: обчислювальні та архітектурні проблеми обробки наддовгих послідовностей

2. Мультимодальний: масштабування контексту за межі тексту до справді мультимодальних середовищ.

8) Можливо, найвищим вираженням контексту є створення «середовищ RL», які ідеально імітують завдання, на яких можна виконати RL.

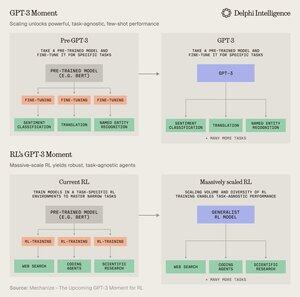

Хоча сьогодні дані обмежені, @MechanizeWork вважає, що ми рухаємося до перегину «в стилі GPT-3» з масово масштабованим RL

9) Однак створення таких середовищ є досить трудомістким і не здається дуже «гірким уроком».

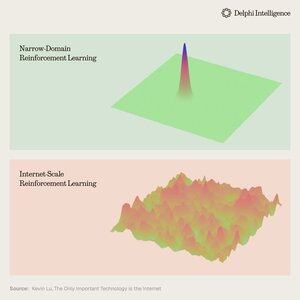

@_kevinlu задається питанням, чи є спосіб використовувати Інтернет для пост-тренувальних занять, як це було зроблено перед тренуванням?

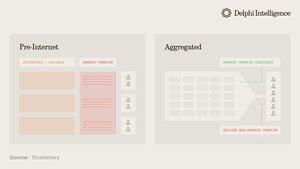

10) Хоча цікава думка, більша частина Інтернету була захоплена кількома великими екосистемами, які вертикально інтегровані та швидко проводять RL через свої інгредієнти для ще швидшого RL

(тобто альфа еволюціонує з @GoogleDeepMind )

11) Неясно, чи розглядають ці великі компанії розрізнені середовища RL як важливе або лише тимчасову зупинку на шляху до повних «світових моделей» з цифровими двійниками майже всіх явищ

Genie 3 від Google, безумовно, є кивком у цьому напрямку:

5 серп., 22:03

Що, якби ви могли не лише переглянути згенероване відео, а й дослідити його? 🌐

Genie 3 — це наша новаторська модель світу, яка створює інтерактивні, ігрові середовища з однієї текстової підказки.

Від фотореалістичних пейзажів до фантастичних сфер – можливості безмежні. 🧵

12) У зв'язку з чим виникає питання: чи вертикально інтегровані підходи до побудови синтетичного інтелекту з більш швидкими петлями зворотного зв'язку RL призначені для прискорення вперед і захоплення ринку, або ж модульні системи латентних обчислень, даних і талантів можуть конкурувати з ефективною оркестровкою?

11,86K

Найкращі

Рейтинг

Вибране