Populære emner

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Hvis du leser én ting denne uken, vil du foreslå AI-rapporten nedenfor:

"Fra datastøperier til verdensmodeller"

Den vever sammen datastøperier, kontekstteknikk, RL-miljøer, verdensmodeller og mer til et tilgjengelig, men likevel omfattende essay om den nåværende kanten av AI.👇(0/12)

Hele artikkelen:

🧵under:

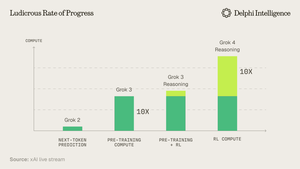

1) Fra Grok 4-utgivelsen er det klart at vi ikke har møtt "en vegg" i beregningsutgifter.

Kilde: @xai

2) I økende grad ser data ut til å være den korte stangen i teltet.

Kilde: @EpochAIResearch

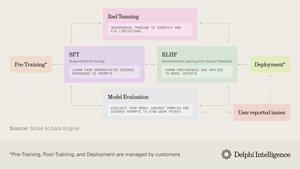

3) Mesteparten av disse utgiftene går til å generere datasett av høy kvalitet for ettertrening som raskt nærmer seg 50 % av databudsjettene

4) Dette har ført til en bøyning i etterspørselen etter "datastøperier" som @scale_AI @HelloSurgeAI @mercor_ai og flere som hjelper til med å skaffe den nødvendige ekspertisen og lage datarørledninger som er avgjørende for RL i ikke-verifiserbare domener ...

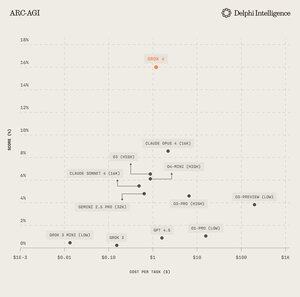

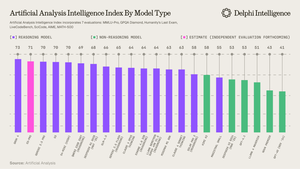

5) Noe som kan bidra til å gi næring til stadig mer dyktige resonneringsmodeller, helt klart skaleringsparadigmet du jour per @ArtificialAnlys

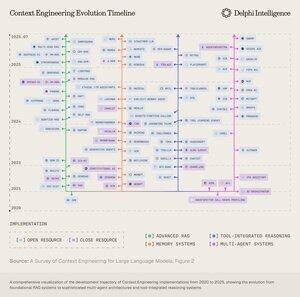

6) Og likevel er modeller ikke lenger begrenset av IQ, men av kontekst. Prompt engineering har gitt stafettpinnen videre til "Context Engineering" - et spirende felt som optimaliserer informasjonsnyttelast til LLM-er.

7) Rommet er ekstremt dynamisk, men innebærer generelt skalering av kontekst på tvers av 2 vektorer:

1. Kontekstlengde: de beregningsmessige og arkitektoniske utfordringene ved behandling av ultralange sekvenser

2. Multimodal: skalering av kontekst utover tekst til virkelig multimodale miljøer.

8) Kanskje det ultimate uttrykket for kontekst eng. er å lage "RL-miljøer" som perfekt etterligner oppgaver som RL kan kjøres på.

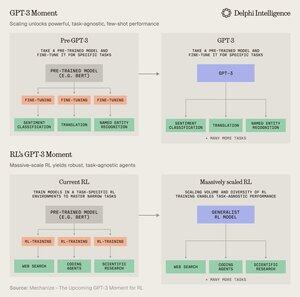

Selv om data er begrenset i dag, mener @MechanizeWork at vi er på vei mot en "GPT-3-aktig" bøyning med massivt skalert RL

9) Å lage disse miljøene er imidlertid ganske arbeidskrevende og virker ikke veldig "bitter-leksjon-pillet".

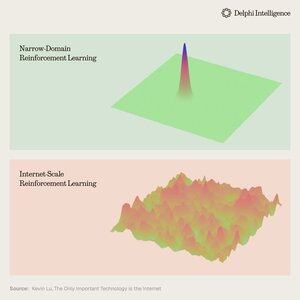

@_kevinlu lurer på om det er en måte å utnytte internett for ettertrening slik det ble gjort for fortrening?

10) Selv om det er en interessant tanke, har mye av internett blitt fanget opp av noen få store økosystemer som er vertikalt integrerte og raskt utfører RL på tvers av ingrediensene sine for enda raskere RL

(dvs. alfa utvikler seg fra @GoogleDeepMind )

11) Det er uklart om disse store selskapene ser på ulike RL-miljøer som essensielle eller bare et midlertidig stopp på vei til fulle «verdensmodeller», komplett med digitale tvillinger av nesten alle fenomener

Genie 3 fra Google er absolutt et nikk i denne retningen:

5. aug., 22:03

Hva om du ikke bare kunne se en generert video, men utforske den også? 🌐

Genie 3 er vår banebrytende verdensmodell som skaper interaktive, spillbare miljøer fra en enkelt tekstmelding.

Fra fotorealistiske landskap til fantasiriker, mulighetene er uendelige. 🧵

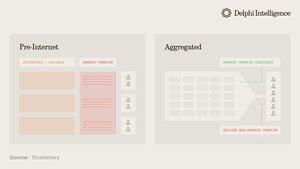

12) Noe som reiser spørsmålet: Er vertikalt integrerte tilnærminger til å bygge syntetisk intelligens med raskere RL-tilbakemeldingssløyfer bestemt til å gå fremover og fange markedet, eller kan modulære systemer med latent databehandling, data og talent konkurrere med effektiv orkestrering?

11,85K

Topp

Rangering

Favoritter