Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

C'est dommage qu'OpenAI ait été moins rigoureux avec leurs tests de GPT-5 qu'avec leurs modèles OS beaucoup plus faibles.

OpenAI dispose des ensembles de données nécessaires pour affiner GPT-5 et mesurer plus précisément les risques de bioweapons de GPT-5 ; ils choisissent simplement de ne pas le faire.

6 août, 01:55

Le crédit où il est dû :

OpenAI a fait beaucoup de choses bien pour ses évaluations de sécurité OSS

- ils ont en fait effectué un certain ajustement

- ils ont reçu des retours externes utiles

- ils ont partagé quelles recommandations ils ont adoptées et lesquelles ils n'ont pas adoptées

Je ne suis pas toujours d'accord avec le raisonnement d'OAI, mais c'est super qu'ils partagent des informations.

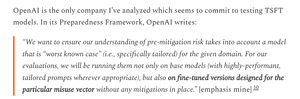

OpenAI utilise les mêmes tests biologiques pour les modèles OS et GPT-5, mais n'a pas créé de version "bio max" de GPT-5, même s'ils l'ont fait pour le modèle plus faible.

C'est peut-être une des raisons pour lesquelles OpenAI "n'a pas de preuves définitives" concernant le fait que GPT-5 soit à haut risque.

Bien sûr, si GPT-5 est volé - quelque chose que tous les grands laboratoires d'IA croient possible - alors OpenAI ne peut pas empêcher les abus, tout comme ils ne peuvent pas le faire pour un modèle OS.

C'est la raison d'effectuer des évaluations finement ajustées : pour connaître le risque maximal réel en cas de vol.

Malheureusement, il n'est pas clair qu'OpenAI ait empêché le vol de son modèle à haut risque, comme l'exige son cadre de préparation.

Le rapport d'OpenAI sur les contrôles de sécurité est assez succinct et ne dit pas 'nous avons investi au niveau spécifique que nous avions promis.' J'aimerais en savoir plus.

Je suis assez confus quant à la raison pour laquelle OpenAI n'a pas effectué d'évaluations fine-tunées pour GPT-5 ; ils ont les ensembles de données et l'infrastructure de fine-tuning.

Autrefois, OpenAI s'était engagé à cette rigueur. Je comprends pourquoi ils pourraient revenir sur leur engagement s'ils n'ont pas les ressources, mais à ce stade, ils semblent clairement les avoir.

1,96K

Meilleurs

Classement

Favoris