Argomenti di tendenza

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

🔥 Lo vedo chiaramente: il futuro sarà esattamente così:

Tutto il software sarà assolutamente liquido e funzionerà direttamente negli LLM. Il software sarà una merce, come l'elettricità.

Vedere questo in anticipo può darti una grande opportunità 🤑 Sarò lì per coglierla.

L'idea in dettaglio:

5 ore fa

"Il software sarà una merce, come l'elettricità, e funzionerà direttamente nel layer LLM."

Cosa significa tutto ciò? Lo spiegherò in dettaglio (post lungo in arrivo 🍿) e una volta che avrai finito non ci sarà via di mezzo. O rifiuterai completamente l'idea (e avrai torto) oppure uscirai convertito e ti darò il benvenuto nel mio culto 😂

Il post di ieri, in cui ho detto che vedo questo avvenire molto chiaramente nel prossimo futuro, ha suscitato molto clamore e domande. Quindi, approfondirò l'idea che ho condiviso qui (e con chiunque non si annoi di me al di fuori di X, a questo punto sono stanco di me stesso) per oltre un anno. Andiamo.

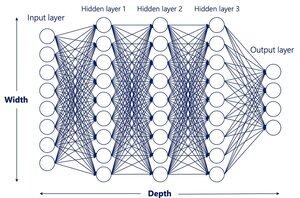

1. ‘Tutto il software funzionerà nel layer LLM’

Prima di tutto, l'ovvio.

Anche oggi ci sono persone che, incredibilmente, negano ancora che stiamo andando verso un mondo in cui tutto il software (frontend, backend, infra, ecc.) è creato con linguaggio naturale semplice.

In realtà, ci siamo praticamente già arrivati con LLM come Claude, Grok o ChatGPT e strumenti come Cursor, Windsurf o Lovable. Qualsiasi sviluppatore decente che conosco non scrive più una sola riga di codice. Parla in linguaggio naturale e dirige sciami di agenti per costruire l'intera app, poi la rivede (e discute e implora 🤣) affinché l'IA realizzi la sua visione.

Quella parte è banale. Se non sei ancora lì, è perché non vuoi esserlo.

Il prossimo salto è molto più grande, ed è dove anche le persone immerse nell'IA mi guardano con scetticismo.

Non avremo nemmeno bisogno di quel layer. Niente Python, niente HTML, niente C++, niente CSS, niente.

Tutto (l'intero layer software, la logica, la persistenza o memoria (chiamala database se vuoi, ma sarà molto più di questo), funzionerà ‘direttamente’ all'interno del LLM.

Elon Musk l'ha riassunto in una frase che passerà alla storia: "Qualsiasi bitstream di input a qualsiasi bitstream di output."

Se conosci la tecnologia, probabilmente non hai bisogno di altro. Se per caso, ecco un esempio veloce.

Oggi, se vogliamo costruire un upscaler come Magnific, abbiamo bisogno di:

- Logica backend, il codice che gira sul server (nel nostro caso, Python)

- Un database (Firebase, Postgres, Supabase, MySQL, ecc.)

- Il layer frontend, ciò che l'utente vede: HTML, CSS, JavaScript

- Il layer infra: GPU cloud dove avviene la magia e dove chiamiamo i flussi di lavoro tramite API

Che circo!

E certo, puoi praticamente costruire questo già con Cursor + Claude. Ma i linguaggi di programmazione sono stati progettati per gli esseri umani. Le future IA non ne avranno bisogno. Sono ridondanti. Un parametro che dovremmo rimuovere. Un'inefficienza.

Pensi davvero che tutto questo sia necessario? Pensi davvero che continueremo a fare le cose in questo modo tra 20 anni?

No. Un futuro LLM, uno che è difficile da immaginare oggi ma che vedremo prima di quanto pensi, potrebbe prendere uno screenshot dell'attuale Magnific e, con solo quell'immagine e un clic o un trascinamento del mouse, inferire cosa deve fare dopo.

INFERIRE COSA DEVE FARE DOPO.

E non intendo dire che costruirà segretamente un frontend, un backend e un database sotto il cofano (quello è medievale). Intendo dire che genererà letteralmente il prossimo frame visivo da mostrare all'utente. Potrebbe essere lo stesso screenshot con il cursore spostato di 1 pixel a destra e l'immagine visualizzata con un upscale leggermente più dettagliato.

Proprio così.

‘Ma… ma… ma… Javi… dove avviene la logica? Dov'è il programma che fa questo?’

Direttamente all'interno del LLM! Allo stesso modo in cui i modelli di oggi possono prendere un'immagine e generare un video completo con fisica decente, capiranno quella che attualmente chiamiamo ‘logica aziendale’ di qualsiasi applicazione, non importa quanto complessa.

"Qualsiasi bitstream di input a qualsiasi bitstream di output."

Logica che emerge dal modello stesso, non da codice artigianale.

Ora probabilmente l'hai capito. Se no, prenditi un minuto per riflettere sull'idea prima di passare al punto successivo, non lasciare che si blocchi in gola.

2. ‘Il software sarà una merce, come l'elettricità’

E non solo il software. Anche tutto l'intrattenimento digitale (film, videogiochi, ecc.). In tempo reale.

La maggior parte del valore della tecnologia digitale si concentrerà in poche aziende. Quelle che vinceranno la corsa agli LLM multimodali e quelle che forniranno l'infrastruttura su cui funzionano. Immagina un mondo in cui dire ‘Voglio un SaaS che faccia questo’ o ‘fammi un film in questo stile con il mio cane come protagonista’ ti dia un risultato istantaneo da un LLM a una qualità ben superiore alle migliori produzioni di oggi.

Penso fondamentalmente che tutta la logica e i layer visivi funzioneranno su LLM ultra-avanzati che possiamo a malapena immaginare oggi. Non avrà senso costruire app, siti o intrattenimento nel modo in cui lo facciamo ora. La capacità di farlo si concentrerà nelle aziende con i migliori LLM e la potenza di calcolo per farli funzionare su larga scala.

Sceglieremo i fornitori di IA principalmente in base al prezzo e molto meno in base alle funzionalità o alla capacità. Pensa alle compagnie elettriche di oggi, o a PS contro Xbox se bloccano alcuni IP interessanti.

3. ‘Ma Javi, non sono deterministici e non hanno memoria. Non costruiranno mai app decenti in questo modo’

Chiamarlo impossibile è miope. Certo che avranno persistenza e memoria. Solo non nel modo semplicistico ‘come un database’ che usiamo oggi.

4. ‘Ok, ma come costruiresti anche un LLM del genere?’

Con attenzione 😂

Principalmente con dati sintetici. Ecco un'idea ovvia che è ancora piuttosto rivoluzionaria.

Poiché gli LLM e gli agenti sono vicini a generare app end-to-end (backend e frontend), possiamo strumentarli per costruire in un ciclo chiuso, con obiettivi espliciti e funzioni di ricompensa, registrando stati e input dell'interfaccia utente. Quelle traiettorie possono alimentare l'addestramento per futuri modelli di base.

Se riesco a pensare a questo con la mia conoscenza limitata (anche se nessuna grande azienda ha detto pubblicamente che lo stanno facendo), posso presumere che menti molto più brillanti siano già al lavoro.

5. ‘Se questo si rivelasse vero, come puoi avere un vantaggio sui non credenti?’

Se hai ragione su qualcosa del genere, sei già avanti. Per ora, la mia mossa è posizionarmi attraverso investimenti, scoprendo quali aziende concentreranno più potere bloccando GPU e tecnologia. Condividerò un link più tardi nel thread, anche se potrebbe essere miope e focalizzato su ciò che esiste oggi. Il miglior consiglio che puoi seguire è seguire il gioco giorno per giorno e rimanere sveglio.

Come ti sembra?

9,12K

Principali

Ranking

Preferiti