Актуальні теми

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

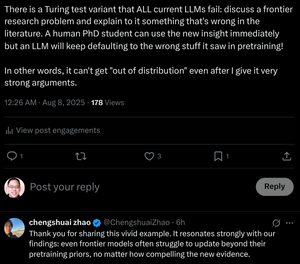

«Навіть передові моделі важко оновитися за межами попередніх тренувальних завдань, незалежно від того, наскільки переконливими є нові докази».

Для цього ми навчаємо аспірантів! Чи можуть трансформери зробити це, не змінюючи свою вагу?

8 серп., 07:29

Чи є міркування ланцюжка думок ЛМ міражем?

... Наші результати показують, що міркування CoT є крихким міражем, який зникає, коли його виштовхують за межі тренувального розподілу. Ця робота пропонує глибше розуміння того, чому і коли міркування CoT зазнають невдачі, наголошуючи на поточній проблемі досягнення справжнього та узагальнюваного міркування.

... Наші результати показують, що міркування CoT ефективно працюють у застосуванні до розподілу або поблизу

Дані в розподілі, але стають крихкими і схильними до збоїв навіть при помірних зрушеннях розподілу.

У деяких випадках LLM генерують плавні, але логічно непослідовні кроки міркування. Результати свідчать про те, що те, що здається структурованим міркуванням, може бути міражем, що виникає з запам'ятовуваних або інтерпольованих шаблонів у тренувальних даних, а не з логічного висновку.

... У сукупності ці результати свідчать про те, що LLM не є принциповими міркуваннями, а скоріше складними симуляторами тексту, схожого на міркування.

12,29K

Найкращі

Рейтинг

Вибране