Trendande ämnen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

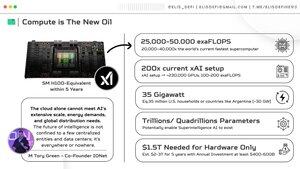

Vet du vad som är konsekvenserna av 50M H100-ekvivalent för att driva AI?

Jag bad bara @grok att svara på det själv och det här är svaret:

➤ Datorkraft ⟶ 25 000–50 000 exaFLOPS (20 000–40 000 gånger världens för närvarande snabbaste superdator)

➤ Träningskapacitet ⟶ Biljoner/ kvadriljoner parametrar

➤ Aktuell xAI-skala ⟶ 200x ströminställning (~230 000 GPU:er, 100-200 exaFLOPS)

➤ Strömförbrukning ⟶ ~35 GW eller strömanvändning för 35 miljoner amerikanska hushåll eller länder som Argentina (~30 GW)

➤ Årlig energi ⟶ ~245 000 GWH eller 6 % av USA:s årliga el (~4 000 TWh)

➤ Kostnad ⟶ Endast 1,5 biljoner dollar hårdvara och uppskattningsvis 2–3 biljoner dollar totalt under 5 år

➤ Årlig investering behövs ⟶ 400-600 miljarder dollar/år

Blotta storleken på denna nationalstat innebär ett globalt skifte från fossila bränslen, hörnstenen i 1900-talet, till datorkraft. Samtidigt är AI-genombrott oundvikliga och kommer att förändra olika sektorer i vårt samhälle.

Som @MTorygreen mycket riktigt påpekade kan molnet ensamt inte möta AI:s omfattande skala, energikrav och globala distributionsbehov.

Framtiden för intelligens är inte begränsad till ett fåtal centraliserade enheter och datacenter; Det är överallt eller ingenstans.

23 juli 2025

Det @xAI målet är 50 miljoner enheter av H100-ekvivalent-AI-beräkning (men mycket bättre energieffektivitet) online inom 5 år

3,99K

Topp

Rankning

Favoriter