Subiecte populare

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Știți care sunt implicațiile echivalentului 50M H100 pentru alimentarea AI?

Tocmai @grok am rugat să răspundă singur și acesta este răspunsul:

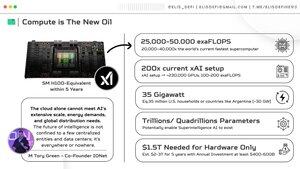

➤ Putere de calcul ⟶ 25.000-50.000 exaFLOPS (20.000-40.000 de ori cel mai rapid supercomputer din lume)

➤ Capacitate de antrenament ⟶ Trilioane/cvadrilioane de parametri

➤ Scara curentă xAI ⟶ Configurație curentă de 200x (~230.000 GPU-uri, 100-200 exaFLOPS)

➤ Consum de energie ⟶ ~35 GW sau consumul de energie a 35 de milioane de gospodării din SUA sau țări precum Argentina (~30 GW)

➤ Energie anuală ⟶ ~245.000 GWH sau 6% din energia electrică anuală din SUA (~4.000 TWh)

➤ Cost ⟶ Numai hardware de 1,5 trilioane USD și estimat 2-3 trilioane USD în total pe 5 ani

➤ Investiții anuale necesare ⟶ 400-600 miliarde USD/an

Dimensiunea acestui stat-națiune semnifică o trecere globală de la combustibilii fosili, piatra de temelie a secolului 20, la puterea de calcul. Între timp, descoperirile AI sunt inevitabile și vor transforma diferite sectoare ale societății noastre.

După cum @MTorygreen subliniat pe bună dreptate, cloud-ul singur nu poate satisface scara extinsă a AI, cererile de energie și nevoile de distribuție globală.

Viitorul informațiilor nu se limitează la câteva entități centralizate și centre de date; este peste tot sau nicăieri.

23 iul. 2025

Obiectivul @xAI este de 50 de milioane de unități de calcul AI echivalent H100 (dar o eficiență energetică mult mai bună) online în 5 ani

3,98K

Limită superioară

Clasament

Favorite