Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Wiesz, jakie są implikacje 50M H100 równoważnych do zasilania AI?

Właśnie poprosiłem @grok, aby odpowiedział na to samodzielnie i oto odpowiedź:

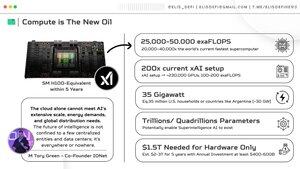

➤ Moc obliczeniowa ⟶ 25,000–50,000 exaFLOPS (20,000–40,000x najszybszego superkomputera na świecie)

➤ Zdolność do treningu ⟶ Tryliony/kwadryliony parametrów

➤ Obecna skala xAI ⟶ 200x obecnej konfiguracji (~230,000 GPU, 100-200 exaFLOPS)

➤ Zużycie energii ⟶ ~35 GW, co odpowiada zużyciu energii 35 milionów gospodarstw domowych w USA lub krajów takich jak Argentyna (~30 GW)

➤ Roczna energia ⟶ ~245,000 GWH, co stanowi 6% rocznej energii elektrycznej USA (~4,000 TWh)

➤ Koszt ⟶ 1,5 biliona dolarów tylko za sprzęt i szacunkowo 2-3 biliony dolarów łącznie w ciągu 5 lat

➤ Roczna inwestycja potrzebna ⟶ 400-600 miliardów dolarów rocznie

Ogrom tego państwa sygnalizuje globalną zmianę z paliw kopalnych, kamienia węgielnego XX wieku, na moc obliczeniową. Tymczasem przełomy w AI są nieuniknione i przekształcą różne sektory naszego społeczeństwa.

Jak słusznie zauważył @MTorygreen, sama chmura nie może sprostać ogromnej skali, wymaganiom energetycznym i potrzebom globalnej dystrybucji AI.

Przyszłość inteligencji nie jest ograniczona do kilku scentralizowanych podmiotów i centrów danych; jest wszędzie lub nigdzie.

23 lip 2025

Celem @xAI jest 50 milionów jednostek obliczeniowych AI równoważnych H100 (ale znacznie lepsza efektywność energetyczna) online w ciągu 5 lat.

4,01K

Najlepsze

Ranking

Ulubione