Trendande ämnen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Öppen källkod för att vinna!

Den 11 juli lanserades Kimi K2 (@Kimi_Moonshot) efter 6 månaders byggande med stängda dörrar. Modellen presterade enastående och gjorde snabbt anspråk på titeln "den bästa LLM-modellen med öppen källkod".

Faktum är att dagen efter att Moonshot tillkännagav Kimi K2, sköt OpenAI:s VD Sam Altman brådskande upp lanseringen av sin nästa öppen källkodsmodell på grund av "säkerhetsskäl", vilket fick folk att undra.

Här är en teknisk uppdelning av den nya toppmoderna LLM som inte bara konkurrerar med proprietära branschjättar som ChatGPT och Claude, utan också utmanar gränserna för en bra öppen källkodsmodell👇🧵

2/5: Kimi K2 är en mix-of-experts (MoE) modell med 32 miljarder aktiverade parametrar tränade på 15,5T tokens, med en kunskapsbas fram till april 2025.

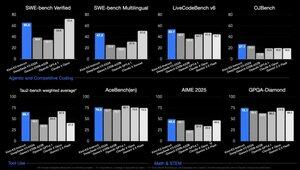

Kimi specialiserar sig på kodning och agentiska uppgifter, med en SWE-bench-poäng som överträffar alla kollegor med öppen källkod, som DeepSeek V3 och Qwen3. Den överträffar till och med vissa proprietära modeller som OpenAI:s GPT-4.1 och Claude 4 Opus när det gäller konkurrenskraftiga kodningsuppgifter med en enda prompt.

Den utmärker sig också vid verktygsanvändning, med en av de bästa Tau2-benchmarkpoängen med öppen källkod, tätt efter Claude 4 Opus.

3/5: Kimis API stöds av OpenAI och Anthropic vilket innebär att du direkt kan exportera autentiseringsnycklarna från och använda dem i Claude-kod för att ersätta Opus eller Sonnet. Den stöder också Cline, vilket innebär att du kan prova Kimi K2 i de flesta kodnings-IDE:er från dess API.

En liten sak att notera är dock att en minsta insättning på cirka $15 (100RMB) krävs för att låsa upp en rimlig RPM (500). Anledningen som anges av Moonshot är att förhindra skadliga attacker. Även om försiktigheten är förståelig med tanke på modellens popularitet, bör framtida utveckling prioritera att förbättra tillgängligheten för användarna.

5/5: Vill du veta mer? Läs deras dokument!

1,57K

Topp

Rankning

Favoriter